Wissenschaftlern aus mehreren Ländern zufolge gibt es keinen Algorithmus, der eine künstliche Superintelligenz steuern kann , was sie potenziell gefährlich für die Menschheit macht.

Künstliche Intelligenz (KI) ist eines der fortschrittlichsten und vielversprechendsten Wissenschaftsgebiete der nahen Zukunft. Von besseren automatischen Handhabungssystemen in Autos, Flugzeugen, Booten oder Massenverkehrssystemen bis hin zu Robotern, wie sie von Boston Dynamics entwickelt wurden, die Zeit, in der KI-Maschinen ein aktiver und sichtbarer Teil unserer Gesellschaft sind, rückt immer näher.

Künstliche Intelligenz (KI) könnte unkontrollierbar sein, sagen Wissenschaftler

Es gibt diejenigen, die diese Fortschritte mit Argwohn und sogar Angst betrachten, vielleicht angeheizt durch so viele Science-Fiction-Geschichten wie das bösartige Skynet aus der Terminator- Saga oder die Androiden aus I, Robot, um nur einige zu nennen. Doch jetzt warnen dieselben Wissenschaftler vor den Gefahren superintelligenter Maschinen, die, wie sie sagen, unkontrollierbar werden könnten.

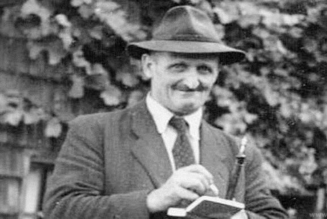

Darauf weist ein internationales Forscherteam, zu dem auch Wissenschaftler des Zentrums für Mensch und Maschine des Max-Planck-Instituts für Bildungsforschung gehören, das anhand theoretischer Berechnungen warnt, dass Künstliche Intelligenz die Menschheit bis zur Gefahr übertreffen kann, denn es wäre grundsätzlich nicht kontrollierbar.

„Eine superintelligente Maschine, die die Welt kontrolliert, klingt nach Science-Fiction. Aber es gibt bereits Maschinen, die bestimmte wichtige Aufgaben selbstständig erledigen, ohne dass der Programmierer vollständig versteht, wie er sie erlernt hat. Daher stellt sich die Frage, ob dies irgendwann unkontrollierbar und gefährlich für die Menschheit werden könnte“, sagt Studien-Co-Autor Manuel Cebrian, Leiter der Digital Mobilization Group am Center for Humans and Machines, Max-Planck-Institut für Bildungsforschung .

Wie könnten wir eine intelligente Maschine steuern?

Die Wissenschaftler haben zwei verschiedene Ideen untersucht, wie man eine superintelligente KI steuern könnte. Einerseits könnten die Fähigkeiten superintelligenter KI gezielt eingeschränkt werden, indem man sie beispielsweise vom Internet und allen anderen technischen Geräten so isoliert, dass sie keinen Kontakt zur Außenwelt hat; dies würde die superintelligente KI jedoch deutlich weniger leistungsfähig machen und weniger in der Lage sein, auf geisteswissenschaftliche Missionen zu reagieren.

Fehlt diese Option, könnte KI von Anfang an motiviert werden, nur Ziele zu verfolgen, die im besten Interesse der Menschheit sind, beispielsweise indem sie ethische Prinzipien einprogrammiert. Allerdings zeigen die Forscher auch, dass diese und andere zeitgenössische und historische Ideen zur Steuerung superintelligenter KI an ihre Grenzen stoßen. In ihrer Studie entwickelte das Team einen theoretischen Eindämmungsalgorithmus, der sicherstellt, dass eine superintelligente KI Menschen unter keinen Umständen schaden kann, indem es zunächst KI-Verhalten simuliert und es stoppt, wenn es als schädlich erachtet wird. Eine sorgfältige Analyse zeigt jedoch, dass ein solcher Algorithmus in unserem aktuellen Rechenparadigma nicht konstruiert werden kann.

„Wenn man das Problem in Grundregeln des theoretischen Rechnens herunterbricht, stellt sich heraus, dass ein Algorithmus, der eine KI anweist, die Welt nicht zu zerstören, versehentlich seinen eigenen Betrieb stoppen könnte. In diesem Fall wüssten Sie nicht, ob der Eindämmungsalgorithmus die Bedrohung noch analysiert oder ob er aufgehört hat, die schädliche KI einzudämmen. Dadurch wird der Eindämmungsalgorithmus praktisch nutzlos“, sagt Iyad Rahwan , Direktor des Center for Humans and Machines.

Nach diesen Berechnungen ist das Problem der Eindämmung unberechenbar, d. h. kein Algorithmus kann eine Lösung finden, um festzustellen, ob eine KI der Welt Schaden zufügen würde. Darüber hinaus zeigen die Forscher, dass wir möglicherweise nicht einmal wissen, wann superintelligente Maschinen angekommen sind, denn die Entscheidung, ob eine Maschine eine überlegene Intelligenz als der Mensch besitzt, liegt im selben Bereich wie das Eindämmungsproblem.